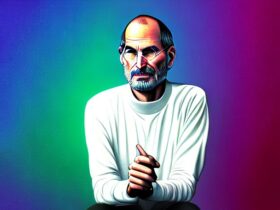

Sommige Republikeinen geloven nog steeds dat de verkiezingen van 2020 "gestolen" van Donald Trump. Lyonstock/Shutterstock

Met meer dan de helft van de wereldbevolking die in 2024 naar de stembus gaat, is het desinformatieseizoen aangebroken – en de waarschuwingen zijn ernstig. Het World Economic Forum heeft desinformatie uitgeroepen tot grootste maatschappelijke bedreiging voor de komende twee jaar en grote nieuwsorganisaties waarschuwen dat desinformatie een ongekende bedreiging vormt voor democratieën wereldwijd.

Toch vragen sommige wetenschappers en deskundigen zich af of desinformatie de verkiezingsuitslag echt kan beïnvloeden. Anderen denken dat de bezorgdheid over desinformatie slechts een morele paniek is of slechts een symptoom in plaats van de oorzaak van onze maatschappelijke problemen. Pollster Nate Silver denkt zelfs dat desinformatie “geen coherent concept is”.

Maar wij beweren dat het bewijs een ander verhaal vertelt.

Een onderzoek uit 2023 toonde aan dat de overgrote meerderheid van de academische experts het eens is over hoe desinformatie gedefinieerd moet worden (namelijk als onjuiste en misleidende inhoud) en hoe dit eruit ziet (bijvoorbeeld leugens, samenzweringstheorieën en pseudowetenschap). Hoewel het onderzoek geen betrekking had op desinformatie, zijn deze experts het er over het algemeen over eens dat dit kan worden gedefinieerd als opzettelijke verkeerde informatie.

Een recent artikel verduidelijkte dat desinformatie zowel een symptoom als de ziekte kan zijn. In 2022 onderschreef bijna 70% van de Republikeinen nog steeds de valse samenzweringstheorie dat de Amerikaanse presidentsverkiezingen van 2020 waren “gestolen” van Donald Trump. Als Trump deze theorie nooit had geopperd, hoe zouden miljoenen mensen deze overtuigingen dan hebben kunnen verwerven?

Hoewel het duidelijk is dat mensen niet altijd handelen naar gevaarlijke overtuigingen, dienen de rellen op 6 januari in het Amerikaanse Capitool, die werden aangewakkerd door valse beweringen, als een belangrijke herinnering dat een verkeerd geïnformeerde menigte de democratie kan verstoren en ondermijnen.

Gezien het feit dat bijna 25% van de verkiezingen beslist wordt met een marge van minder dan 3%, kan verkeerde en desinformatie een belangrijke invloed hebben. Uit een onderzoek bleek dat onder eerdere Barack Obama-stemmers die tijdens de presidentsverkiezingen van 2016 niet in nepnieuws over Hillary Clinton trapten, 89% op Clinton stemde. Onder eerdere Obama-stemmers die ten minste twee valse krantenkoppen over Clinton geloofden, stemde daarentegen slechts 17% voor haar.

Hoewel dit niet noodzakelijkerwijs bewijst dat de verkeerde informatie het stemgedrag veroorzaakte, weten we wel dat miljoenen zwarte kiezers in de aanloop naar de verkiezingen het doelwit waren van misleidende advertenties die Clinton in diskrediet brachten in belangrijke swing states.

Onderzoek heeft aangetoond dat dergelijke micro-targeting van specifieke doelgroepen op basis van

variabelen zoals hun persoonlijkheid niet alleen de besluitvorming beïnvloedt, maar ook de stemintentie. In een recent artikel werd geïllustreerd hoe grote taalmodellen kunnen worden ingezet om op schaal microgerichte advertenties te maken, waarbij werd geschat dat voor elke 100.000 personen die worden getarget er minstens enkele duizenden kunnen worden overgehaald.

We weten ook dat mensen niet alleen slecht zijn in het onderscheiden van deepfakes (door AI gegenereerde beelden van nepgebeurtenissen) van echte inhoud, maar dat onderzoeken ook aantonen dat deepfakes de politieke houding van een kleine doelgroep beïnvloeden.

Er zijn ook meer indirecte gevolgen van desinformatie, zoals het uithollen van het vertrouwen van het publiek en de deelname aan verkiezingen.

Wat kunnen we doen om onszelf te beschermen, behalve ons onder ons bed verstoppen en ons zorgen maken?

De kracht van prebunking

Veel inspanningen zijn gericht op het controleren van feiten en het ontkrachten van valse overtuigingen. Prebunking” daarentegen is een nieuwe manier om te voorkomen dat valse overtuigingen überhaupt ontstaan. Een dergelijke “inenting” bestaat uit het waarschuwen van mensen om niet in een vals verhaal of propagandatactiek te trappen, samen met een uitleg waarom.

Misleidende retoriek heeft duidelijke kenmerken, zoals zondebokvorming of het gebruik van valse dichotomieën (er zijn er nog veel meer), die mensen kunnen leren herkennen. Net als een medisch vaccin, stelt de prebunk de ontvanger bloot aan een “verzwakte dosis” van de besmettelijke stof (de desinformatie) en weerlegt deze op een manier die bescherming biedt.

We hebben bijvoorbeeld een online spel gemaakt voor het Department of Homeland Security om Amerikanen in staat te stellen buitenlandse beïnvloedingstechnieken te herkennen tijdens de presidentsverkiezingen van 2020. De verzwakte dosis? Pizza met ananas.

Hoe kan ananaspizza nou de manier zijn om desinformatie aan te pakken? Het laat zien hoe acteurs uit het slechte geloof een onschuldige kwestie als het wel of niet smeren van ananas op pizza kunnen gebruiken om een cultuuroorlog te ontketenen. Ze kunnen beweren dat het beledigend is voor Italianen of er bij Amerikanen op aandringen zich door niemand te laten beperken in hun vrijheid om pizza’s te beleggen.

Ze kunnen dan bots kopen om de kwestie aan beide kanten te versterken, het debat te verstoren – en chaos te zaaien. Onze resultaten toonden aan dat mensen deze tactieken beter herkenden na het spelen van onze inentingsgame.

In 2020 identificeerde Twitter valse verkiezingstrofeeën als potentiële “vectoren van desinformatie” en stuurde prebunks naar miljoenen Amerikaanse gebruikers om hen te waarschuwen voor frauduleuze beweringen, zoals dat stemmen per post niet veilig is.

Deze prebunks wapenden mensen met een feit – dat experts het erover eens zijn dat stemmen per post betrouwbaar is – en het werkte in zoverre dat de prebunks vertrouwen wekten in het verkiezingsproces en gebruikers motiveerden om meer feitelijke informatie te zoeken. Andere sociale mediabedrijven, zoals Google en Meta, hebben dit voorbeeld gevolgd op verschillende gebieden.

Een nieuw artikel testte inenting tegen valse beweringen over het verkiezingsproces in de VS en Brazilië. Niet alleen bleek dat prebunking beter werkte dan traditionele debunking, maar ook dat de inoculatie het onderscheid tussen ware en valse beweringen verbeterde, de overtuiging van verkiezingsfraude effectief verminderde en het vertrouwen in de integriteit van de komende verkiezingen van 2024 verbeterde.

Kortom, inenting is een interventie die het vrije woord versterkt en die op wereldwijde schaal kan werken. Toen Rusland op zoek was naar een voorwendsel om Oekraïne binnen te vallen, gebruikte de Amerikaanse president Joe Biden deze aanpak om de wereld te “inoculeren” tegen Poetins plan om een verzonnen Oekraïense gruweldaad in scène te zetten en te filmen, compleet met acteurs, een script en een filmploeg. Biden declasseerde de inlichtingen en onthulde het complot.

In feite waarschuwde hij de wereld om niet te trappen in nepvideo’s met acteurs die zich voordeden als Oekraïense soldaten op Russisch grondgebied. De internationale gemeenschap was gewaarschuwd en zou er waarschijnlijk niet intrappen. Rusland vond natuurlijk een ander excuus om binnen te vallen, maar het punt blijft: gewaarschuwd is gewaarschuwd.

Maar we hoeven niet te vertrouwen op de overheid of techbedrijven om mentale immuniteit op te bouwen. We kunnen allemaal leren hoe we verkeerde informatie kunnen herkennen door de markeringen te bestuderen die horen bij misleidende retoriek.

Vergeet niet dat polio een zeer besmettelijke ziekte was die werd uitgeroeid door vaccinatie en kudde-immuniteit. Onze uitdaging is nu om kudde-immuniteit op te bouwen tegen de trucs van desinformanten en propagandisten.

De toekomst van onze democratie kan ervan afhangen.

![]()

Sander van der Linden adviseert voor of ontvangt financiering van de Britse regering's Cabinet Office, het Amerikaanse ministerie van Buitenlandse Zaken, de American Psychological Association, het Amerikaanse Center for Disease Control, de Europese Commissie, de Templeton World Charity Foundation, de Verenigde Naties, de Wereldgezondheidsorganisatie, Google en Meta.

Lee McIntyre adviseert de Britse regering over het bestrijden van desinformatie.

Stephan Lewandowsky ontvangt financiering van de Europese Onderzoeksraad (ERC Advanced Grant 101020961 PRODEMINFO), de

Humboldt Stichting door middel van een onderzoeksprijs, de Volkswagen Stichting (subsidie “Reclaiming individual autonomy and democratic discourse online: How to rebalance human and algorithmic decision making''), en de Europese Commissie (Horizon 2020-subsidies 964728 JITSUVAX en 101094752 SoMe4Dem). Hij ontvangt ook financiering van Jigsaw (een technologie-incubator opgericht door Google) en van UK Research and Innovation (via EU Horizon replacement funding grant nummer 10049415). Hij werkt samen met het Gemeenschappelijk Centrum voor Onderzoek van de Europese Commissie's.